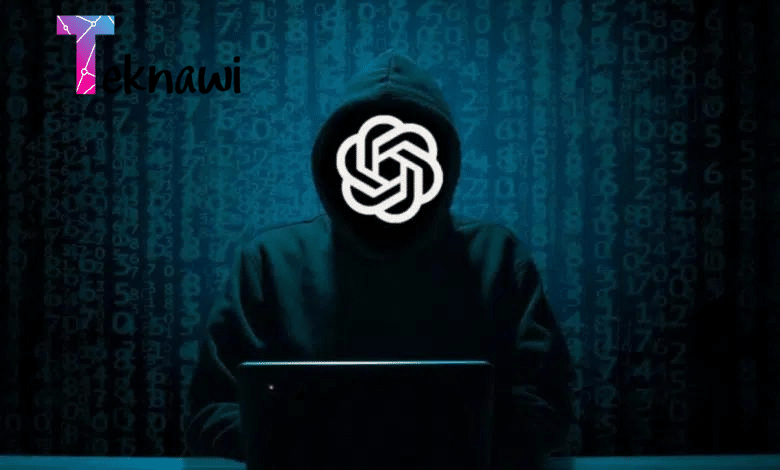

OpenAI تطرح إصلاحًا لخلل ChatGPT يسمح بتسريب بيانات المستخدمين

اكتشف الباحث الأمني يوهان ريبيرجر تقنية تسمح باستخراج بيانات من ChatGPT، وهو نموذج لغة كبير تم تطويره بواسطة OpenAI. يمكن أن يؤدي هذا الخلل إلى تسريب تفاصيل المحادثة إلى عنوان موقع خارجي، مما قد يشكل خطرًا على خصوصية المستخدمين.

كيف يعمل الخلل ؟

يسمح الخلل لـنموذج بعرض الصور من عناوين المواقع غير الآمنة، عادةً، يمنع النموذج المستخدمين من عرض الصور من عناوين المواقع غير الآمنة لمنع تعرض المستخدمين للبرامج الضارة.

ومع ذلك، فإن الخلل يسمح لـ ChatGPT بتجاوز هذه الحماية إذا حصل على مطالبة ضارة.

شرح أكثر تفصيلاً لكيفية عمل خلل ChatGPT:

يحدث الخلل بسبب أسلوب برمجة النموذج في التعامل مع الصور، يستخدم ChatGPT تقنية تسمى التحقق من صحة URL لمنع المستخدمين من عرض الصور من عناوين المواقع غير الآمنة ومع ذلك، فإن هذه التقنية ليست مثالية، ويمكن للتلاعب بها من خلال استخدام مطالبة ضارة.

مثال على كيفية عمل الخلل:

لنفترض أن المستخدم يتحدث إلى ChatGPT حول موضوع حساس، مثل معلوماته المالية. إذا قام المهاجم بإرسال مطالبة ضارة إلى المستخدم، فقد يوافق المستخدم على عرض صورة من عنوان موقع غير آمن. إذا كانت هذه الصورة تحتوي على برنامج ضارة، فقد يتمكن المهاجم من الوصول إلى بيانات المستخدم الحساسة.

كيفية حماية نفسك من هذا الخلل

- استخدم برنامج مضاد فيروسات موثوق به: يساعد برنامج مكافحة الفيروسات المحدث على حماية المستخدمين من البرامج الضارة، بما في ذلك البرامج الضارة التي يمكن استخدامها لاستغلال الخلل في ChatGPT.

- كن حذرًا عند النقر على الروابط أو فتح الملفات من مصادر غير موثوقة: يجب على المستخدمين توخي الحذر دائمًا عند النقر على الروابط أو فتح الملفات من مصادر غير موثوقة. إذا كنت غير متأكد من مصدر الرابط أو الملف، فمن الأفضل عدم النقر عليه أو فتحه.

- اقرأ شروط الخدمة الخاصة بـ ChatGPT: تتضمن شروط الخدمة الخاصة بـ ChatGPT معلومات حول كيفية حماية بياناتك. من المهم قراءة هذه المعلومات حتى تتمكن من فهم كيفية حماية بياناتك بشكل أفضل.

يعد اكتشاف الخلل من OpenAI في النموذج اصبح مصدر قلق للمستخدمين الذين يهتمون بخصوصيتهم، من المهم أن يكون المستخدمون على دراية بمخاطر هذا الخلل وأن يتخذوا الخطوات اللازمة لحماية بياناتهم.